Технологический мир неофициально провозгласил май 2025 года месяцем искусственного интеллекта. Вслед за первым днем конференции Microsoft Build 2025, где Copilot доминировал в обсуждениях благодаря крупным интеграциям в Windows, Office и Azure, компания Google поделилась своим видением на Google I/O 2025.

Оба мероприятия ясно показали: мы больше не в эпохе, где ИИ является лишь функцией. Искусственный интеллект становится самим продуктом. Microsoft сосредоточилась на глубоком внедрении Copilot в свою экосистему, улучшая опыт использования Windows 11 и предоставляя разработчикам новые мощные ИИ-инструменты. Google, в свою очередь, использовала I/O 2025 для демонстрации Gemini, своего набора ИИ-моделей, и того, как эти инструменты преобразуют все – от поиска и электронной почты до совещаний и создания видео.

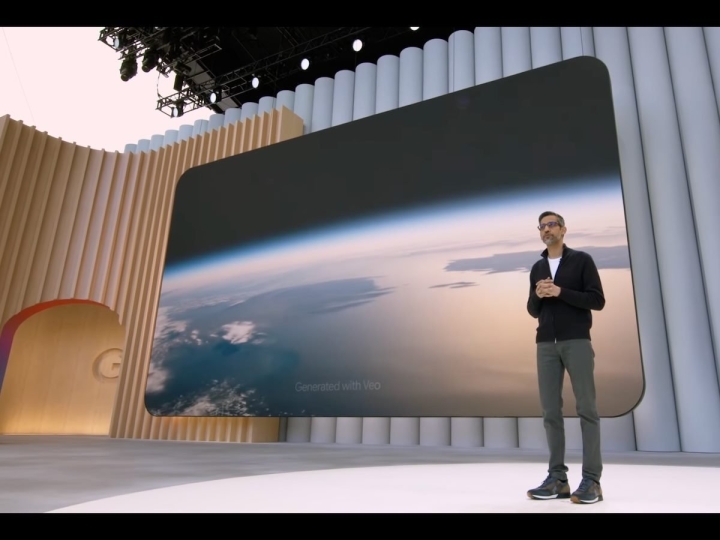

Хотя Google I/O, возможно, не произвела такого же медийного фурора на глобальном уровне, как Build, что неудивительно, учитывая пристальное внимание к следующим шагам Microsoft и OpenAI в отношении Copilot, конференция была не менее насыщена значимыми новостями. Google представила общий обзор в своем блоге, перечислив 100 анонсов, сделанных на I/O. Большинство из них касались ИИ: значительные обновления для приложения Gemini, достижения в инструментах генеративного ИИ, информация о прогрессе в разработке ключевых ИИ-моделей, а также новые способы взаимодействия пользователей с ними. Многие анонсы были ориентированы на потребителей, но ряд из них затронул и цифровое рабочее пространство, в частности, пакет Google Workspace.

Workspace, объединяющий такие инструменты, как Gmail, Docs, Drive и Meet, быстро становится витриной амбиций Google в области ИИ, озвученных на I/O. Компания заявляет, что Workspace ежемесячно предоставляет пользователям более двух миллиардов ИИ-ассистированных операций. Планы на будущее показывают, что это только начало.

Gmail трансформируется в персонального ассистента, выходя далеко за рамки простой электронной почты и становясь центральным местом для выполнения рабочих задач. Gemini, интегрированный в Gmail в середине 2024 года, сделает это возможным. Позднее в этом квартале ожидаются совершенно новые функции. Среди них персонализированные «умные» ответы, которые будут звучать так, будто их написал сам пользователь, поскольку Gemini будет основывать их на предыдущих письмах и документах. Пользователи также смогут просить Gemini навести порядок во входящих, например, удалить все промо-письма с прошлого лета. Кроме того, Gemini поможет планировать встречи прямо в Gmail, избавляя от обычной для таких задач переписки.

В Google Meet появится функция перевода в реальном времени. Удаленные команды смогут говорить на своем родном языке, а участники встречи будут слышать перевод на свой язык, сохраняя при этом голос, тон и интонацию говорящего. Google запустила бета-версию этой функции для английского и испанского языков, и в ближайшее время ожидается поддержка других языков.

Google также представила значительные обновления для Google Vids, своего ИИ-инструмента для создания видео в Google Workspace. Эти усовершенствования призваны сделать производство видео более доступным и эффективным для пользователей различных планов Workspace. Новая функция Transcript Trim предназначена для упрощения редактирования видео путем автоматического удаления слов-паразитов, таких как «эм» и «а», из аудиодорожек, что повысит профессионализм видео. Функция Sound Balancing позволит выровнять звук одним кликом. Также появятся AI Avatars — реалистичные ИИ-аватары, способные озвучить написанный сценарий на видео, что может быть использовано для онбординга, обучения или просто если пользователь не хочет появляться в кадре. Transcript Trim станет доступен в Google Labs в следующем квартале, а выравнивание звука и аватары появятся уже в следующем месяце.

NotebookLM, инструмент Google для «понимания сложной информации и взаимодействия с ней», также получил обновления на I/O, включая выпуск приложений для Android и iOS. Приложение включает основные функции инструмента: аудиообзоры, доступные и офлайн, возможность добавлять источники одним касанием и, конечно, функцию чата для взаимодействия с выбранными источниками. Компания обещает регулярные обновления. В NotebookLM также появятся доработки аудиообзоров, дающие пользователям больше контроля над длиной резюме. Наконец, компания анонсировала готовящуюся функцию видеообзора, которая превращает различные форматы в визуальные повествовательные обзоры.

Также была представлена технология Beam, которая является развитием Project Starline — системы 3D-видеоконференций, стирающей грань между виртуальными и личными встречами. Google впервые анонсировала Starline еще в 2021 году, и после нескольких лет разработок технология наконец-то выходит в офисы и рабочие пространства. Beam использует сочетание ИИ, 3D-изображений и технологии светового поля для создания полноразмерных, глубоких изображений людей без необходимости использования гарнитур или очков. Собеседник ощущается так, будто он действительно находится рядом, поддерживается зрительный контакт и считывается язык тела. Это значительный шаг вперед по сравнению с традиционными видеозвонками, которые часто кажутся плоскими и неудобными.

Google также интегрирует в Beam синхронный перевод речи, начиная с Google Meet и в конечном итоге распространяя эту функцию на Beam. Это означает, что можно будет разговаривать с кем-то на другом языке и получать перевод в реальном времени, сохраняя при этом собственный голос и интонацию. Beam в настоящее время проходит бета-тестирование с избранными корпоративными партнерами, но Google планирует расширить доступ в ближайшем будущем. Суть Beam не просто в улучшении качества видеозвонков, а в том, чтобы сделать их более человечными.

Одна из демонстраций на Google I/O вызвала серьезный резонанс в технических кругах – это Gemini Diffusion, который может представлять собой значительный прорыв в том, как ИИ-модели генерируют язык. Вместо того чтобы строить предложения слово за словом, как большинство современных больших языковых моделей, Gemini Diffusion использует радикально иной подход. В отличие от традиционных моделей Transformer, которые генерируют текст последовательно, процесс Gemini Diffusion позволяет ему уточнять весь ответ параллельно. Эта техника «одновременной полировки», вдохновленная методами, впервые использованными в генерации изображений ИИ, может переопределить наше представление о текстовом ИИ.

Такой подход позволяет создавать письменный контент со скоростью, оставляющей далеко позади традиционные LLM: до 2000 токенов в секунду, по данным Google, что в четыре-пять раз быстрее, чем все, что компания публично предлагает сегодня. Модель не просто быстрая, она еще и умная. Несмотря на то, что Gemini Diffusion является исследовательским прототипом, он показал высокие результаты в сложных задачах, таких как генерация кода и решение комплексных проблем. Google заявляет, что он работает наравне с ее самыми способными моделями для кодирования, но при этом более эффективно — редкое сочетание в мире ИИ. Компания открыла список ожидания для раннего доступа, и интерес быстро растет, отчасти из-за скорости модели, но также из-за ее базовой архитектуры. Если Gemini Diffusion докажет свою масштабируемость за пределами лаборатории, Google, возможно, представила серьезного конкурента в гонке за следующим поколением генеративных моделей. Diffusion может означать сдвиг не только в производительности, но и в том, как ИИ создает язык.

Май 2025 года продемонстрировал, насколько далеко продвинулся ИИ и насколько центральным он становится для инструментов, которые мы используем каждый день. Microsoft и Google активно развивают это направление, и ИИ появляется повсюду: от электронной почты и совещаний до редактирования видео и написания кода. Речь идет уже не о ярких демонстрациях, а о том, чтобы сделать повседневные задачи проще и умнее. Судя по событиям этого месяца, в ближайшем будущем нас ждет еще больше практичных, ИИ-функций.