На сегодняшний день прогнозирование привлекательности лица (FAP) в основном изучалось в контексте психологических исследований, в индустрии красоты и косметики, а также в контексте косметической хирургии. Это сложная область исследования, поскольку стандарты красоты, как правило, имеют национальный, а не глобальный характер.

Это означает, что ни один единственный эффективный набор данных на основе ИИ не может быть жизнеспособным, так как средние значения, полученные из выборки лиц/оценок из всех культур, будут очень искаженными (где более населенные страны получат дополнительный вес) или не применимыми к никакой культуре (где среднее значение нескольких рас/оценок уравняется к отсутствию действительной расы).

Вместо этого задача состоит в разработке концептуальных методологий и потоков работы, в которые можно было бы интегрировать данные, специфичные для стран или культур, чтобы обеспечить разработку эффективных моделей FAP для различных регионов.

Сферы применения FAP в исследованиях красоты и психологии довольно ограничены, либо специфичны для индустрии; поэтому большинство наборов данных, созданных на сегодняшний день, содержат лишь ограниченные данные или вообще не были опубликованы.

Легкая доступность онлайн-прогнозаторов привлекательности, в основном ориентированных на западную аудиторию, не обязательно отражает современные достижения в FAP, которые в настоящее время, похоже, доминируют исследованиями Восточной Азии (в первую очередь в Китае) и соответствующими наборами данных из Восточной Азии.

Широкие коммерческие применения оценки красоты включают приложения для онлайн-знакомств и генеративные ИИ-системы, предназначенные для «подправки» реальных изображений аватаров людей (так как такие приложения требуют квантованного стандарта красоты в качестве метрики эффективности).

Рисование лиц

Привлекательные личности продолжают быть ценным активом в рекламе и строительстве влияния, создавая финансовые стимулы в этих секторах, что представляет собой четкую возможность для продвижения современного набора данных и структур FAP.

Например, модель ИИ, обученная на реальных данных для оценки и рейтинга красоты лица, потенциально может выявлять события или личности с высоким потенциалом для рекламного воздействия. Эта возможность особенно актуальна в контексте прямых видеотрансляций, где такие метрики, как «подписчики» и «лайки», в настоящее время служат лишь неявными индикаторами способности личности (или даже типа лица) захватывать аудиторию.

Это, конечно, поверхностная метрика, и голос, презентация и точка зрения также играют значительную роль в привлечении аудитории. Поэтому кураторство наборов данных FAP требует человеческого контроля, а также способности различать лицевую от «пустой» привлекательности (без чего вне доменные влиятельные лица, такие как Алекс Джонс, могут оказать влияние на среднюю кривую FAP для коллекции, предназначенной исключительно для оценки красоты лица).

LiveBeauty

Для решения нехватки наборов данных FAP исследователи из Китая предлагают первый крупный набор данных FAP, содержащий 100 000 изображений лиц, а также 200 000 аннотаций людей, оценивающих красоту лиц.

Под названием LiveBeauty набор данных включает 10 000 различных личностей, все захваченные с (неуточненных) платформ для прямых трансляций в марте 2024 года.

Авторы также представляют метод FPEM, новую многомодальную методику FAP. FPEM интегрирует целостные знания о лице и многомодальные эстетические семантические признаки через Модуль Персонализированного Привлекательного Параметра (PAPM), Модуль Многомодальной Привлекательности (MAEM) и Модуль Слияния Модальностей (CMFM).

Статья утверждает, что FPEM достигает современных результатов на новом наборе данных LiveBeauty и других наборах данных FAP. Авторы отмечают, что исследования имеют потенциальные приложения для повышения качества видео, рекомендации контента и ретуширования лиц в прямых трансляциях.

Авторы также обещают сделать набор данных доступным «скоро» — хотя следует признать, что любые лицензионные ограничения, присущие исходной области, вероятно, передадутся большинству применимых проектов, которые могут использовать эту работу.

Новая статья называется Прогнозирование привлекательности лица в прямой трансляции: новая база данных и многомодальный метод, и принадлежит десяти исследователям из Alibaba Group и Шанхайского университета Цзяо Тун.

Метод и данные

Из каждого 10-часового эфира с платформ прямых трансляций исследователи отобрали по одному изображению каждый час на протяжении первых трех часов. Были выбраны трансляции с наибольшим количеством просмотров.

Собранные данные затем подвергались нескольким этапам предварительной обработки. Первым из них является измерение размера лицевой области, которое использует модель обнаружения FaceBoxes на базе CPU 2018 года для генерации ограничивающего прямоугольника вокруг лицевых черт. Процесс обеспечивает, чтобы более короткая сторона ограничивающего прямоугольника превышала 90 пикселей, избегая маленьких или нечетких лицевых областей.

Вторым этапом является обнаружение размытия, которое применяется к лицевой области с использованием дисперсии оператора Лапласиана в канале высоты (Y) лицевого обрезка. Эта дисперсия должна превышать 10, что помогает отсеивать размазанные изображения.

Третий этап — это оценка позы лица, которая использует модель оценки позы 3DDFA-V2 2021 года.

Здесь рабочий процесс гарантирует, что угол наклона обрезанного лица не превышает 20 градусов, а угол поворота — 15 градусов, что исключает лица с экстремальными позами.

Четвертым этапом является оценка пропорции лица, которая также использует сегментационные возможности модели 3DDFA-V2, обеспечивая, чтобы пропорция обрезанной лицевой области превышала 60% изображения, исключая изображения, где лицо не является выраженным, т.е. маленьким на общем фоне.

Наконец, пятым этапом является удаление дубликатов лиц, которое использует современную модель распознавания лиц (без указания источника) для случаев, когда одна и та же личность появляется более чем в одном из трех изображений, собранных для 10-часового видео.

Оценка и аннотирование людьми

Были привлечены двадцать аннотаторов, состоящих из шести мужчин и 14 женщин, отражающих демографию используемой платформы прямых трансляций*. Лица отображались на 6.7-дюймовом экране iPhone 14 Pro Max при стабильных лабораторных условиях.

Оценка была разделена на 200 сессий, каждая из которых использовала 50 изображений. Участникам предложили оценить привлекательность лиц по шкале от 1 до 5, с пяти минутами перерыва между каждой сессией, и все участники принимали участие во всех сессиях.

Таким образом, все 10 000 изображений были оценены двадцатью людьми, в результате чего было получено 200 000 аннотаций.

Анализ и предварительная обработка

Сначала была произведена проверка участников с использованием отношения выбросов и коэффициента ранговой корреляции Спирмена (SROCC). Участники, чьи оценки имели SROCC менее 0.75 или отношение выбросов более 2%, считались ненадежными и были удалены, в итоге было отобрано 20 участников.

Затем был вычислен средний балл мнений (MOS) для каждого изображения лица путем усреднения оценок, полученных от валидных участников. MOS служит истинной меткой привлекательности для каждого изображения, и оценка рассчитывается путем усреднения всех индивидуальных оценок от каждого валидного участника.

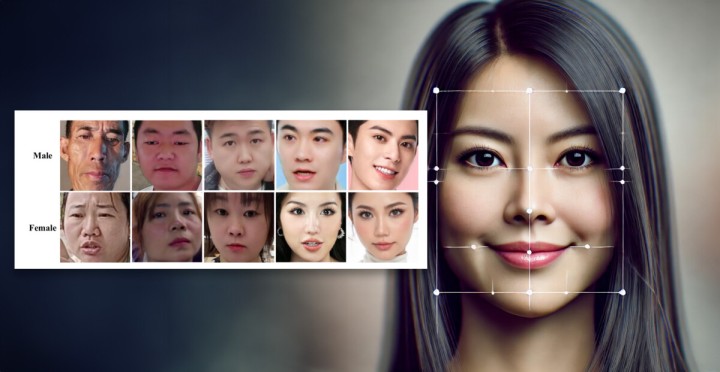

Наконец, анализ распределения MOS для всех образцов, а также для образцов женского и мужского пола, показал, что они демонстрируют гауссовидную форму, что соответствует распределениям привлекательности лиц в реальном мире.

Большинство людей имеют среднюю привлекательность лица, с меньшим количеством людей на крайностях очень низкой или очень высокой привлекательности.

Более того, анализ значений асимметрии и куртозиса показал, что распределения характеризуются тонкими хвостами и сконцентрированы вокруг средней оценки, и что высокая привлекательность была более распространена среди женских образцов в собранных видео из прямых трансляций.

Архитектура

Для модели FPEM (Facial Prior Enhanced Multi-modal) и Гибридной Фазы Слияния в LiveBeauty использовалась двустадийная стратегия обучения, разделенная на четыре модуля: Модуль Персонализированного Привлекательного Параметра (PAPM), Модуль Многомодальной Привлекательности (MAEM), Модуль Слияния Модальностей (CMFM) и Модуль Слияния Решений (DFM).

Модуль PAPM принимает изображение на вход и извлекает многоуровневые визуальные признаки с помощью Swin Transformer, а также извлекает лицевые признаки с использованием предварительно обученной модели FaceNet. Эти признаки затем комбинируются с использованием блока перекрестного внимания для создания персонализированного признака «привлекательности».

Также в Предварительной Обучающей Фазе MAEM использует изображение и текстовые описания привлекательности, используя CLIP для извлечения многомодальных эстетических семантических признаков.

Шаблонные текстовые описания имеют вид «фото человека с {a} привлекательностью» (где {a} может быть плохим, убогим, приемлемым, хорошим или идеальным). Процесс оценивает косинусное сходство между текстовыми и визуальными встраиваниями для определения вероятности уровня привлекательности.

В Гибридной Фазе Слияния CMFM уточняет текстовые встраивания с использованием персонализированного признака привлекательности, генерируемого PAPM, тем самым создавая персонализированные текстовые встраивания. Затем он использует стратегию регрессии сходства для прогнозирования.

Наконец, DFM объединяет индивидуальные прогнозы от PAPM, MAEM и CMFM, чтобы получить единый финальный балл привлекательности, целью которого является достижение устойчивого консенсуса.

Функции потерь

Для метрик потерь PAPM обучается с использованием L1 потерь, что является мерой абсолютной разницы между предсказанным баллом привлекательности и фактическим (истинным) баллом привлекательности.

Модуль MAEM использует более сложную функцию потерь, которая сочетает в себе потерю оценки (LS) с объединенной функцией потерь ранжирования (LR). Функция потерь ранжирования (LR) включает в себя потерю доверия (LR1) и двунаправленную функцию потерь ранжирования (LR2).

LR1 сравнивает относительную привлекательность пар изображений, в то время как LR2 гарантирует, что предсказанное распределение вероятностей уровней привлекательности имеет единственный пик и уменьшается в обоих направлениях. Этот комбинированный подход направлен на оптимизацию как точной оценки, так и правильной сортировки изображений по привлекательности.

Модули CMFM и DFM обучаются с использованием простой L1 потери.

Тесты

В тестах исследователи сопоставили LiveBeauty с девятью предыдущими подходами: ComboNet; 2D-FAP; REX-INCEP; CNN-ER (представленный в REX-INCEP); MEBeauty; AVA-MLSP; TANet; Dele-Trans; и EAT.

Также были протестированы базовые методы, соответствующие протоколу оценки эстетики изображений (IAA). К ним относятся ViT-B; ResNeXt-50; и Inception-V3.

Кроме LiveBeauty, были протестированы и другие наборы данных: SCUT-FBP5000 и MEBeauty. Ниже сравниваются распределения MOS этих наборов данных.

Соответственно, эти два набора данных были разделены 60%-40% и 80%-20% для обучения и тестирования, чтобы сохранить согласованность с их оригинальными протоколами. LiveBeauty был разделен на основе 90%-10%.

Для инициализации модели в MAEM использовались VT-B/16 и GPT-2 в качестве кодировщиков изображений и текста соответственно, инициализированные по настройкам из CLIP. Для PAPM использовалась Swin-T в качестве обучаемого кодировщика изображений в соответствии с SwinFace.

Использовался оптимизатор AdamW, и планировщик скорости обучения был установлен с линейным наращиванием на основе косинусного отжига. Скорости обучения различались по фазам обучения, но каждая имела размер пакета 32, на протяжении 50 эпох.

Результаты тестов

Результаты тестов на трех наборах данных FAP позволили сделать следующие выводы:

‘Наш предложенный метод занимает первое место и превосходит второе место примерно на 0.012, 0.081, 0.021 по значениям SROCC на LiveBeauty, MEBeauty и SCUT-FBP5500 соответственно, что демонстрирует превосходство нашего предложенного метода.

‘[Методы] IAA уступают методам FAP, что проявляется в том, что общие методы оценки эстетики не учитывают лицевые характеристики, вовлеченные в субъективную природу привлекательности лица, что приводит к плохой производительности в задачах FAP.

‘[Производительность] всех методов значительно снижается на MEBeauty. Это связано с тем, что образцы для обучения ограничены, и лица этнически разнообразны в MEBeauty, что указывает на большую разнообразие в привлекательности лиц.

‘Все эти факторы делают прогнозирование привлекательности лица в MEBeauty более сложным.

Этические соображения

Исследования привлекательности могут быть потенциально предвзятыми, так как при установлении якобы эмпирических стандартов красоты такие системы склонны усиливать предвзятости, связанные с возрастом, расой и многими другими аспектами компьютерного зрения, связанными с людьми.

Можно утверждать, что система FAP изначально предрасположена к усилению и поддержанию частичных и предвзятых взглядов на привлекательность. Эти суждения могут произрастать из беглых оценок, проводимых людьми — зачастую проводимых по шкалам, слишком ограниченным для эффективной генерализации области — или из анализа паттернов внимания в онлайн-средах, таких как стриминговые платформы, которые, можно утверждать, далеки от меритократии.