Выявление текущего уровня суицидального риска у тех, кто звонит на кризисные службы или телефоны доверия по борьбе с самоубийствами, имеет решающее значение для выявления и предотвращения самоубийств.

Речь передает полезную информацию о психическом и эмоциональном состоянии человека, позволяя понять, грустит ли он, злится или боится. Исследования суицидальной речи проводятся уже более 30 лет, и в ходе них выявляются объективные акустические маркеры, которые могут быть использованы для дифференциации различных психических состояний и расстройств психики, включая депрессию.

Однако выявление суицидального риска по речи человека может быть сложной задачей для слушателя, поскольку люди, звонящие на эти горячие линии, эмоционально нестабильны, и их речевые характеристики могут быстро меняться.

Возможно, может помочь эмоциональная «панель мониторинга» в режиме реального времени. Алаа Нфисси, аспирант Университета Конкордия в Монреале, Канада, обучила модель искусственного интеллекта распознавать речевые эмоции (SER), чтобы помочь в предотвращении самоубийств. В этом году он представил доклад о своей работе на Международной конференции IEEE по семантическим вычислениям в Калифорнии, где он получил награду за лучшую студенческую работу.

“Традиционно SER проводился вручную квалифицированными психологами, которые комментировали речевые сигналы, что требовало большого количества времени и опыта”, — сказал Нфисси. “Наша модель глубокого обучения автоматически извлекает речевые характеристики, которые имеют отношение к распознаванию эмоций”.

Для обучения модели Nfissi использовала базу данных с записями реальных звонков, сделанных на горячие линии для самоубийц, в сочетании с записями актеров, выражающих определенные эмоции. Записи были разбиты на сегменты и снабжены комментариями, отражающими конкретное психическое состояние: гнев, грусть, нейтральность, страх/озабоченность. Записи актеров были объединены с оригинальными, реальными записями, потому что эмоции гнева и страха/озабоченности/беспокойства были недостаточно представлены.

Модель Нфисси смогла точно распознать четыре эмоции. В объединенных наборах данных он правильно определил, что человек испытывает страх/озабоченность/обеспокоен в 82% случаев, грустен в 77%, зол в 72% и нейтрален в 78% случаев. Модель особенно хорошо справилась с определением сегментов реальных звонков, показав 78% успеха в отношении грусти и 100% — в отношении гнева.

Модель искусственного интеллекта точно определила четыре эмоции: грусть, гнев, нейтральность и страх/беспокойство/заинтересованность

Нфисси надеется, что его модель будет использована для разработки информационной панели в режиме реального времени, которая поможет операторам кризисных линий выбирать подходящие стратегии реагирования на звонки.

“Многие из этих людей страдают, и иногда простое вмешательство консультанта может во многом помочь”, — сказал Нфисси. “Мы надеемся, что эта [модель искусственного интеллекта] будет гарантировать, что вмешательство поможет им и в конечном итоге предотвратит самоубийство”.

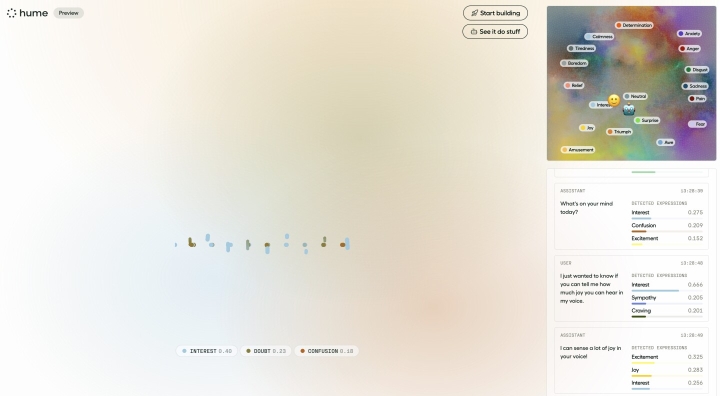

В конечном счете, такого рода эмпатические ИИ вполне могут заменить целые горячие линии по борьбе с самоубийствами. Рассмотрим Hume, который рекламируется как первый голосовой ИИ, предназначенный для интерпретации эмоций и генерирования эмпатических реакций. Вы можете проверить это, посетив веб-сайт Hume, где искусственный интеллект сообщает вам, какие эмоции он может уловить в вашем голосе, и пытается соответствующим образом скорректировать тон своего ответа.

Голосовой чат с чутким ИИ Хьюма, который определил, что я был радостным… и смущенный Хьюм

И даже без этой технологии, позволяющей реагировать на эмоции, разговорные ИИ начинают преобладать в других областях индустрии колл-центров; недавно Financial Times опубликовала статью, в которой К. Критхивасан, генеральный директор и управляющий директор индийской IT-компании Tata Consultancy Services, сказал, что искусственный интеллект может в конечном итоге устранить необходимость в колл-центрах, в которых работает много людей в таких странах, как Филиппины и Индия.

Таким образом, потеря работы, безусловно, вызывает беспокойство, но эмпатический ИИ поднимает еще больше проблем. В прошлом месяце New Atlas сообщил, что когда GPT-4 от OpenAI предоставили информацию о поле, возрасте, расе, образовании и политической ориентации человека и попросили использовать эту информацию для аргументации, характерной для этого человека, она оказалась на 81,7% более убедительной, чем у людей.

Искусственный интеллект уже продемонстрировал, насколько он искусен в сборе огромного объема информации – такой, как этническая принадлежность, масса тела, личностные черты, привычки к употреблению наркотиков, страхи и сексуальные предпочтения – с помощью технологии отслеживания глаз. Вам нужно какое–то специальное приспособление, чтобы отслеживать взгляд, но если ваш голос может так сильно выдать ваши эмоции, что ж, у вас в кармане есть устройство, которое может подслушивать.

Не так уж сложно представить мир, в котором смартфоны, оснащенные искусственным интеллектом, отслеживают эмоции в наших голосах и на наших лицах, а затем используют ваше текущее состояние, а также все остальное, что они знают о вас, чтобы порекомендовать продукт, блюдо, фильм или песню, которые будут соответствовать вашему настроению. твое настроение. Или манипулируют вами, заставляя купить страховку жизни, новую машину, платье или поездку за границу.

Вы попали в точку, если заметили цинизм (я уверен, что ИИ тоже бы заметил). Конечно, менее циничная обратная сторона заключается в том, что эмпатический ИИ может быть использован в здравоохранении для оперативного взаимодействия с пациентами, особенно с теми, у кого нет близких или кто страдает слабоумием. Мы могли бы увидеть подобные вещи раньше, чем позже. В марте 2024 года технологический гигант NVIDIA объявил о партнерстве с Hippocratic AI для создания «медицинских агентов» на базе искусственного интеллекта, которые превосходят по производительности и стоимости медсестер-людей.

Как и в большинстве случаев, связанных с быстро развивающимся ИИ, время покажет, к чему мы в конечном итоге придем.

Статья Нфисси была представлена в 2024 году на 18-й Международной конференции IEEE по семантическим вычислениям (ICSC).

Источник: Университет Конкордия.

© «ПостИИ» (postii.ru), перевод на русский язык