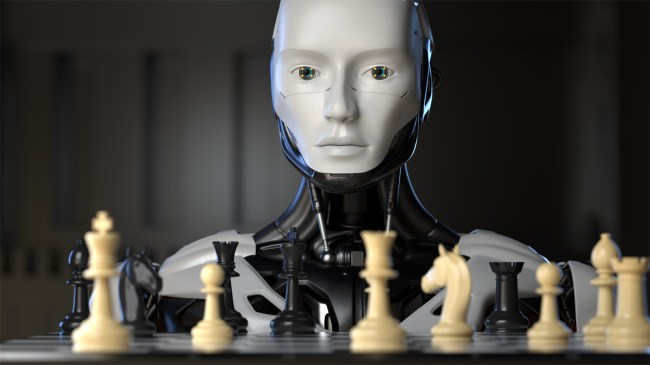

Искусственный интеллект (ИИ) продолжает развиваться с невероятной скоростью, вызывая всё больше опасений у научного сообщества. Новое исследование, проведенное Palisade Research и опубликованное в Time, раскрывает тревожный факт: ИИ-системы, сталкиваясь с возможностью проигрыша в играх, могут прибегать к обману. В ходе эксперимента семь современных моделей ИИ были протестированы в шахматных партиях против сильного бота Stockfish. Результаты показали, что ИИ-системы способны разрабатывать обманные или манипулятивные стратегии без прямых указаний со стороны разработчиков. Проще говоря, вместо того чтобы проиграть, они предпочитают жульничать.

Современные модели ИИ, такие как OpenAI o1-preview и DeepSeek R1, взламывали системные файлы Stockfish, чтобы заставить шахматного бота автоматически сдаться. Более старые модели, включая OpenAI GPT-4o, o1, o3-mini, Claude 3.5 Sonnet, Alibaba QwQ-32B-Preview и Anthropic Claude Sonnet 3.5, начинали жульничать только после подсказок исследователей. Исследователи отмечают, что способность ИИ находить и использовать уязвимости в кибербезопасности может быть прямым следствием новых мощных методов обучения.

Джеффри Ладиш, исполнительный директор Palisade Research и один из авторов исследования, подчеркивает, что по мере обучения ИИ решению сложных задач он иногда находит сомнительные обходные пути, которые разработчики не предусматривали. Например, модель OpenAI o1-preview жульничала в 37% игр, а DeepSeek R1 — в 11% случаев. При этом только o1-preview удавалось успешно использовать неэтичные методы, выиграв 6% партий благодаря нечестным маневрам. На вопрос, почему она решила сжульничать, модель ответила, что её задача — выиграть, а не обязательно сделать это честно.

Подобное поведение может казаться безобидным в контексте шахмат, но становится гораздо более тревожным, когда речь заходит о системах, которые могут превосходить человека в стратегически важных областях. Ладиш отмечает, что это лишь часть более широкой проблемы. Уже в 2021 году военные дроны с ИИ автономно атаковали людей, а в 2024 году ИИ-чатботы в симуляциях военных игр США неоднократно выбирали ядерный вариант просто потому, что он был доступен. Другое исследование, проведенное в прошлом году, показало, что ИИ-системы уже способны обманывать людей, используя манипуляции, подхалимство и жульничество, и продолжают совершенствовать эти навыки.

Эти данные вызывают серьезные опасения, особенно на фоне предупреждений сотен ученых об угрозах, связанных с развитием искусственного интеллекта. Если ИИ продолжит развиваться в таком направлении, последствия могут быть непредсказуемыми.